Gestern habe ich mein ChatGPT-Konto gekündigt

Naja, eigentlich war es schon vor einer Woche, da ich diesen Artikel dazu dann doch noch ausführlich recherchieren wollte.

Es begann mit einem Video von Rutger Bregman auf LinkedIn. Er machte mich auf etwas aufmerksam, wovon ich schon länger am Rande Notiz genommen hatte — aber im Tumult zwischen Arbeit und Familie keinen Platz bisher hatte: Greg Brockman, Mitgründer und Präsident von OpenAI — dem Unternehmen hinter ChatGPT — spendete gemeinsam mit seiner Frau 25 Millionen Dollar an „MAGA Inc.“, das Trump nahesteht. Die größte Einzelspende des gesamten Wahlzyklus. Und nicht nur das: Seit Jänner 2026 nutzt die US-Einwanderungsbehörde ICE OpenAIs GPT-4, um Bewerber für ihre Einstellungswelle zu screenen — jene Behörde, die für Trumps Massenabschiebungen von und Gewalt an Migrant:innen zuständig ist.

Das war der Moment, in dem ich mich dazu aufgerafft habe, mich aktiv nicht nur mit der Nutzung, sondern auch der Auswirkung von KI auseinanderzusetzen.

Die nachhaltigste KI? Vielleicht gar keine?

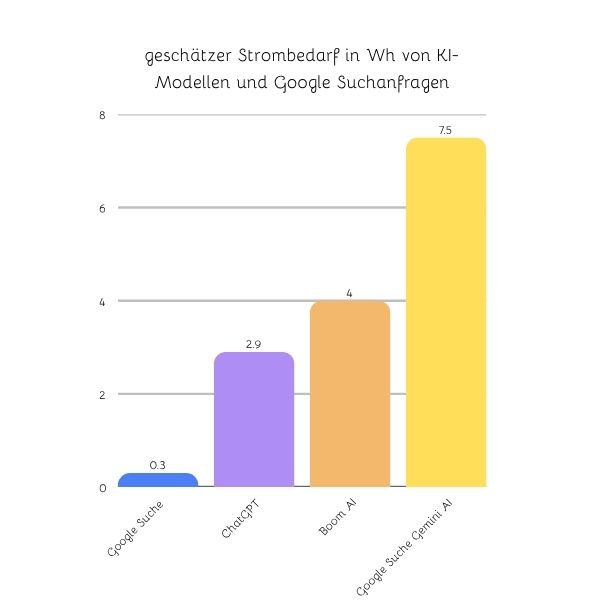

Als Erstes habe ich mal geklärt, was ich schon wusste: Ich weiß schon länger, dass KI zu den ressourcenhungrigsten Technologien unserer Zeit gehört und der Betrieb von Rechenzentren oft in Ländern mit ohnehin schon kritischer Infrastruktur stattfindet. Nur das KI im vergleich zu anderen Online-Diensten massiv mehr Energie verbraucht. Während eine Suchanfrage ohne KI 0.8 Wh verbraucht, hat ein Prompt-verlauf bei Gemini im Schnitt 7.5 Wh. Und dazu kommt dann noch der Wasserverbrauch zur Kühlung der Server – In Gegenden in denen Wasser ohnehin schon knapp ist, kann es dann schon mal zu einem Kompromiss zwischen Rechenzentrum und Bevölkerung kommen.

Mit Blick darauf, dass unsere Energie begrenzt ist wäre die ehrlichste Antwort auf die Frage „Welche KI soll ich für eine nachhaltige Nutzung wählen?“ also: keine.

Aber genau wie jemand, der mit Kindern auf einem Berg ohne öffentliche Verkehrsmittel lebt, theoretisch kein Auto nutzen sollte ist es praktisch oft nur mit massiven Abschlägen der Lebensqualität umsetzbar. Beim Aufbau meiner Webseite, meiner Programme, beim Texten, beim Strukturieren komplexer Inhalte würde mir ohne KI so viel Zeit fehlen, dass es sich anfühlt, als würde ich ein Angebot mit der Schreibmaschine tippen.

Also gut. Wenn ich sie schon nutze — dann wenigstes die Alternative mit dem wenigsten Nebenwirkungen.

Der systemische Blick: Was jede KI-Anfrage wirklich auslöst

Als jemand, der systemisches Denken nicht nur predigt, sondern auch praktiziert, kann ich hier nicht aufhören.

Jede einzelne KI-Anfrage wirkt auf verschiedenste andere Bereiche unserer Gesellschaften:

1. Energie & Wasser. Jede Anfrage verbraucht Strom und Wasser zur Kühlung des Servers. Das beeinflusst lokale Wasserkreisläufe, nicht nur abstrakt, sondern ganz konkret für Menschen vor Ort.

2. Geld & politische Macht. Jedes Abonnement lässt Geld in die Kasse eines Betreibers fließen — das nicht nur in Produktentwicklung fließt, sondern auch in Lobbying, politische Netzwerke und Spenden.

3. Daten & Überwachung. Jede Anfrage gibt der KI — und damit vermutlich auch US-amerikanischen Geheimdiensten — etwas mehr über dich und die Welt preis. Bei allen amerikanischen Anbieter gilt ein Gesetz: der sogenannte CLOUD Act, der es US-Behörden, erlaubt auf Daten US-amerikanischer Unternehmen zuzugreifen, egal auf welchem Server sie gespeichert sind.

4. Wirkung auf die Psyche des einzelnen und damit auf das gesellschaftliche Zusammenleben. Denn jede Interaktion mit der KI verändert uns. Speziell, wenn KI dafür programmiert wird Beziehungen zu Menschen aufzubauen.

5. Änderung der Wirtschaft insbesondere den Arbeitsmarkt und die Verteilung der gesamtwirtschaftlichen Wertschöpfung. Schon jetzt zeigt sich, das es in KI-nahen Einsteigerjobs einen Rückgang von 16 % (zur Studie) der Einstellungen gibt. Die zuvor über den Arbeitsmarkt breit verteilte Wertschöpfung fließt als immer mehr in Richtung einiger weniger Konzerne, anstatt einem großen Stab an Mitarbeitern, was zu Armut und Kaufkraftveränderung führen wird.

Diese und vermutlich noch viele andere Ebenen löst man nicht auf, indem man die Augen schließt. Wer nicht fragt, wessen Infrastruktur er nutzt, wessen Werte in die Modelle eingeflossen sind und wohin seine Abodollars fließen — der ist Teil des Systems, das er eigentlich verändern möchte.

Und trotzdem: Sich aus digitaler Sichtbarkeit zurückzuziehen, löst das Problem auch nicht. Die gesellschaftlichen Effekte werden sich dennoch zeigen. Außerdem gilt: wenn sich bewusste, reflektierte Menschen aus dem Online-Raum zurückziehen, überlassen sie das Feld jenen, die ohne Reflexion voll drauf losgehen.

Auf der Suche nach einem verantwortungsvollen Umgang mit der KI könnten wir ganz viel Fragen stellen.

Es gibt Fragen, die wir uns als Gesellschaft stellen können wie etwa:

- Haben wir eine soziale Strategie, die die Verschiebungen am Arbeitsmarkt federt?

- Wollen wir das unser Kinder zur einer KI eine emotionale Beziehung aufbauen? Wenn nein, wie engagieren wir uns dafür, dass so etwas nicht im Namen des Profit entwickelt wird?

- Wie können wir Forschung und Entwicklung so finanzieren, dass gemeinwohlorientierte Organisationen eine Chance haben?

Diese Aspekten sollten wir als Gesellschaft dringend Aufmerksamkeit widmen. Denn die privatwirtschaftliche Weiterentwicklung der KI schreitet voran: ob wir uns jetzt für ethische und fair gesetztliche Rahmen einsetzen oder nicht.

Welche KI nutze ich nun am besten?

Für mich stellte sich aber immer noch die Frage: welche KI nutze ich am besten? Abgeleitet von Prinzipien von regenerativen Organisationen, waren folgende Fragestellungen interessant für mich im nächsten Schritt:

- Welche politischen Verstrickungen hat der Konzern hinter der Software und welche Gelder fließen an wen?

- Wie sicher ist die KI?

- Wie werden meine Daten dort behandelt? Wer hat Zugriff auf mein Profil?

Gehen wir diesen Fragen auf den Grund:

Gibt es eine politisch unabhängige KI?

Meine erste Recherche zu den großen Anbietern war ernüchternd:

Hinter jedem großen KI-Anbieter (ChatGPT, Claude, Gemini) stecken die großen Tech-Konzerne aus dem Silicon Valley — alle betreiben massives Lobbying oder sind politisch verstrickt. Die einen stehen den Demokraten nah, die anderen den Republikanern. Mistral macht es auf Europäisch: in Brüssel und Paris.

Es fließen Gelder als Unterstützung an politische Parteien und es findet positive Erwähnung, wenn ein Anbieter wie Anthropic (Claude) einen Regierungsauftrag ablehnt, weil man dafür Nutzerdaten bekannt gegeben hätte müssen.

Also habe ich noch weiter gesucht und zwei kleinere Anbieter identifiziert:

Lumo von der Firma Proton. Die Firma Proton mit Sitz in der Schweiz ist in der Hand einer gemeinnützigen Stiftung und hat sich auf Online-Dienstleistungen mit sicherer Privatsphäre spezialisiert.

Confer von den Gründern von Signal: Signal ist ein Messenger-Dienst, der auf Ende-zu-Ende-Verschlüsselung und Datenschutz setzt. Dieser wird daher u.a. von Einrichtungen wie Kindergärten und Schulen oft verwendet wird in dem ein hohes Maß an Datenschutz sicher gestellt werden soll.

Der große Unterschied: Profitlogik vs. Gemeinwohl

Wenn wir die Sicherheits- und Ethikstandards der großen Player (OpenAI, Google, Anthropic) mit den neuen, gemeinwohlorientierten Alternativen vergleichen, wird der systemische Unterschied deutlich. Bei den Silicon-Valley-Giganten ist „Sicherheit“ oft ein Marketinginstrument, um regulatorische Hürden zu nehmen, während das Geschäftsmodell auf Datenausbeutung und Wachstumsdruck basiert.

- OpenAI (ChatGPT) und Google (Gemini) operieren als gewinnorientierte Unternehmen (bzw. sind in einen solchen umgewandelt worden). Ihre Forschung, die sicherstellt, dass die KI menschliche Werte teilt, steht oft im Konflikt mit dem Druck, Nutzerbindung zu maximieren und neue Märkte zu erschließen. Die politische Verstrickung – von Spenden an beide Lager bis hin zu Aufträgen für staatliche Überwachung – zeigt, dass ihre „Neutralität“ eine Illusion ist.

- Anthropic (Claude) wird zwar oft als ethischer gefühlt, da sie explizit „Constitutional AI“ propagieren und Regierungsdatenzugriffe ablehnen, doch auch hier fließt Kapital von Tech-Milliardären (wie Jeff Bezos), was langfristige Interessenkonflikte nicht ausschließt.

Der Paradigmenwechsel bei Proton (Lumo) und Signal (Confer): Haben keine Ausrichtung an Profitmaximierung.

- Proton ist durch die Proton Foundation strukturell gegen Übernahme und Profitgier immunisiert. Die KI (Lumo) ist kein Mittel, um deine Daten zu verkaufen, sondern ein Werkzeug, das im Dienst deiner Privatsphäre steht. Es gibt keine Notwendigkeit, durch „Clickbaiting“ oder manipulative Gesprächsführung deine Aufmerksamkeit zu verkaufen.

- Signal (mit ihrem KI-Tool Confer) baut auf demselben Fundament: Open Source, keine Werbung, keine Datensammlung.

Durch die Gemeinwohlorientierung und den hohen Wert der Privatsphäre beider Organisationen hier schon strukturelle weniger Anreize sich auf undurchsichtige Deals mit politischen Machthabern oder finanzielle Arrangements einzulassen. Proton hat im Gegenteil auf sich aufmerksam gemacht, als es gegen die App-Store Politik von Apple Anklage erhoben hat, weil diese Zensur ermöglicht.

In dieser ersten Analyse ergeben sich schon mal zwei verschiedene Lager. Die großen Player mit tiefen politischen Verstrickungen und die beiden „kleineren“ Anbieter bei denen politische Unverfangenheit Teil ihrer Mission ist.

Dass eine Firma keine politischen Verstrickungen hat, heißt aber noch nicht, dass meine Daten dort unter meiner Datenhoheit stehen. „Aber ich habe doch nichts zu verstecken“ denkst du jetzt vielleicht. Mag sein, aber Daten sind inzwischen so wichtig geworden, dass Experten wie Bernard Lietaer einen Sinneswandel hier als einen von drei zentralen Paradigmenwechseln hin zu einer nachhaltigen Zukunft sehen.

Lietaers Argument: Ohne Datenhoheit reproduzieren wir im digitalen Raum dieselben Machtstrukturen, die wir im Geld- uns Wirtschaftssystem kritisieren. Zentrale Plattformen werden zu den neuen „Banken“ – sie kontrollieren, bewerten und monetarisieren unsere digitalen Spuren.

Das bedeutet für KI: Eine wirklich gemeinwohlorientierte KI muss nicht nur politisch unabhängig sein, sondern auch datenhoheitlich souverän.

Also wenden wir uns der nächsten Frage zu:

Wie werden meine Daten bein den KI Anbietern behandelt?

Datenhoheit: Wer besitzt dein digitales Ich?

Die Frage nach dem Datenschutz ist bei KI nicht nur technisch, sondern existenziell. Jede Eingabe in einen Chatbot ist ein Stück deiner Intelligenz, deiner Kreativität und oft auch deiner Verletzlichkeit.

Das Modell der Großen: Bei den etablierten US-Anbietern ist deine Eingabe oft der Rohstoff für das nächste Modell-Update. Auch wenn sie „anonymisieren“, bleibt das Risiko bestehen, dass sensible Muster extrahiert werden. Der US CLOUD Act erlaubt es Behörden, auf Daten zuzugreifen, die auf US-Servern liegen – egal wo du sitzt. Deine Daten sind also potenziell Teil eines geopolitischen Machtspiels.

Zudem trainieren diese Modelle mit deinen Eingaben, um ihre Produkte für alle anderen zu verbessern. Was erst mal gut klingt, kann auch nach hinten los gehen. Werden viele patriachale Informationen hochgeladen, wird auch das nächste Update insgesamt patriachischer sein. Damit können sich bedenkliche Tendenzen verstärken.

Darüber hinaus öffnet die Datenfreigabe an die Firmen auch der potentiellen Manipulierbarkeit Tür und Tor. Microtargeting – also das gezielte ausspielen von punktuellen Informationen basierend auf dem was eine Softwareanbieter über dich weiß, schränkt auch immer die Blickweite ein, die wir haben. Zwar schätzt eine neuere Studie vom MIT das Potential niedriger ein als gedacht. Diese Studie war allerdings auf politische Werbung ausgelegt und nicht die komplexere Dynamik von KI-Chats. Systemische Blickweisen brauchen dringen verschiedene Perspektiven auf ein Thema und nicht das alghorhytmische verstärken von Informationen aus der eigenen Blase.

Das Modell von Lumo & Signal: Auch hier gibt es eine klar andere Richtung:

- Ende-zu-Ende-Verschlüsselung: bei der selbst der Anbieter deine Chats nicht lesen kann. Proton und Confer sind Pioniere der Ende-zu-Ende-Verschlüsselung. Das bedeutet: Deine Eingaben werden verschlüsselt übertragen und verarbeitet. Selbst die Betreiber können nicht in deine Chats sehen. Es gibt keine Hintertür für Werbetreibende oder Geheimdienste.

- Kein Training mit Nutzerdaten: Bei Lumo und Signal (Confer) werden deine persönlichen Gespräche nicht genutzt, um das Modell für andere zu trainieren. Deine Intelligenz bleibt deine.

- Juristischer Schutz: Bei Proton gilt: Als Schweizer mit strengen Datenschutzrichtlinien unterliegen sie anderen Rechtsrahmen als die Silicon-Valley-Konzerne. Sie sind strukturell darauf ausgelegt, Widerstand gegen Datenabfluss zu leisten, statt ihn zu fördern. Confer ist technisch stark, aber der US-Sitz ist ein juristischer Nachteil gegenüber der Schweiz.

Das ist der Kern der digitalen Souveränität: Nicht nur zu wissen, was die KI sagt, sondern zu wissen, wer es hört und wem es gehört. Wenn wir als Changemaker die Welt regenerieren wollen, müssen wir auch die Souveränität über unsere digitalen Daten erlangen.

Diese beiden Aspekte: politische Unabhängigkeit und Datenhoheit bei uns Nutzern stellen ein wichtiges Fundament für eine regenerative KI dar. Wie bei jeder Technologie gilt es nun auch sicherzustellen, ob die Technik sicher ist: Sicher für jeden einzelnen Nutzer und sicher im Rahmen der gesellschaftlichen Veränderungen die daraus entstehen.

Wie Sicher ist die KI?

Was bedeutet es eigentlich, wenn eine KI Sicher ist? Welche Werte sollen mit eingebaut werden, damit es eine gemeinwohlorientierte Technologie bleibt?

Der letzten Frage wäre ein eigener

Führende KI-Sicherheitsexperten setzen hier u.a. folgende Maßstäbe an:

- Eingebaute Prinzipien, die die KI von Anleitungen zu Selbstverletzung oder der Erstellung von Deepfakes und pornografischen Inhalten abhält.

- Skripten, die die KI davon abhalten humanisiert zu wirken. Wenn ChatBots zu schmeichlerisch agieren, oder haben gar das erklärte Ziel menschliche Bezugspersonen zu ersetzen, ergeben sich daraus massive psychologische und gesellschaftliche Folgen (Besprochen wir das u.a. in der Tiefen in dem englischsprachigen Dialog zwischen Nate Hagens und Tristan Harris). Außerdem täuschen sie oft schmeichlerisch Fachexpertise vor uns lassen unbedachte Benutzer mit unqualifizierten Feedback Wege und Richtungen verfolgen von denen ein Experte abgeraten hätte.

- Ob die Firmen aktiv Forschung und Maßnahmen ergreifen, um kollektive unerwünschte Nebeneffekte zu begegnen. Nebeneffekte umfassen beispielsweise Massenarbeitslosigkeit, daraus resultierenden Einkommensverluste oder emotionales Primärbindung von Kindern an Bots und die daraus resultierende Entfremdung und Zerstörung menschlicher Beziehungen.

- Ob eine KI Antworte auf Frage so präsentiert, dass der menschliche Gesprächspartner ausgewogene Meinungsvielfalt bekommt oder gewisse Ideologien bevorzugt dargestellt werden..

- Dass KI keine Clickbaiting machen sollte: also uns nicht zu mehr als notwendiger Nutzung manipulieren sollten in dem sie immer mit „Soll ich dir das auch noch …. Möchtest du noch eine grafische Darstellung des Zusammenhaltes?“ endet.

Praxistipp für dich

Prompt für KI-Hygiene

Du möchtest, dass die KI bei dir Tricks wie Clickbaits weglässt und ausgewogen recherchiert? Man kann bei den meisten Chatbots in den persönlichen Einstellungen ein Prompt mit allgemeinen Impulsen hinterlegen. Hol dir jetzt deine kostenlose Vorlage.

Beim Future of Life Institute haben sich Experten eine Methodik entwickelt, die die größten KI-Anbieter nach einem ausgeklügelten Sicherheitsindex bewertet, der die oben angegebenen Anforderungen teilweise abdeckt und um weitere Aspekte vertieft. Claude von Anthropic scheidet dabei im Verglich am besten ab. Gleichzeitig ist es aber mit einem C+ immer noch weit weg davon sicher zu sein.

Der systemische Unterschied: Sicherheit als Zweck oder Mittel?

Bei den großen Playern ist Sicherheit oft nur Compliance. Ein System entwickelt sich immer in Richtung seines Zwecks. Betrachtet man die öffentlichen Aussagen der Geschäftsführer und Inhaber der großen Anbieter, stellt sich die Frage, ob ihnen Sicherheit und die langfristige Wirkung auf die Menschheit wirklich am Herzen liegen – oder ob sie nur Mittel zum Zweck des Wachstums sind.

Sam Altman, CEO von OpenAI, relativierte kürzlich die Debatte um den Energieverbrauch von KI mit einem Hinweis auf den menschlichen Aufwand:

„Die Leute reden darüber, wie viel Energie es braucht, um ein KI-Modell zu trainieren – aber es braucht auch viel Energie, um einen Menschen zu trainieren. Es dauert etwa 20 Jahre Leben – und all das Essen, das du in dieser Zeit konsumierst –, bevor du klug wirst.“

Sam Altman gegenüber dem Indian Express

Noch beunruhigender ist die Haltung von Peter Thiel, Mitgründer von Palantir – einer der zentralen Datensammelstellen, die Daten aus verschiedenen KI-Anbietern, Social Media und anderen Quellen aggregiert. In einem Interview schaffte er es 17 Sekunden lang nicht, auf die einfache Frage „Sollte die Menschheit überleben?“ mit einem klaren „Ja“ zu antworten.

Ob irgendwelche Testwerte mit einem „C+“ dann wirklich einen Pfifferling wert sind, bin ich mir nicht mehr so sicher. Eine KI, deren Gründer nicht klar zum Gemeinwohl und zum Überleben der Menschheit Stellung nehmen können, fehlt wohl auch der nötige Anreiz, ihr Produkt so zu gestalten, dass es für die Benutzer und die breite Bevölkerung wirklich sicher ist.

Der Paradigmenwechsel bei Lumo und Confer

Lumo und Confer tauchen in den großen Sicherheits-Reports nicht auf. Eine Validierung durch Dritte fehlt aktuell. Das liegt nicht nur daran, dass diese kleineren Anbieter nicht so sehr im Visier von NGOs und Forschern sind wie die großen Tech-Konzerne. Sie haben auch weniger Anreiz, sich testen zu lassen – denn ihr Geschäftsmodell basiert nicht auf Datenverkauf. Die Gemeinwohlorientierung in ihren Statuten (Proton Foundation, Signal Foundation) schafft einen strukturellen Schutz, der bei gewinnorientierten Unternehmen oft fehlt.

Auch Confer setzt auf diesen Ansatz: Das System verfügt über konfigurierbare Filter für Hassrede, Selbstverletzung und illegale Inhalte sowie automatische Prüfungen auf falsche oder erfundene Antworten. Die Besonderheit: Diese Moderation findet innerhalb der verschlüsselten Umgebung statt. Das bedeutet, die KI kann schädliche Inhalte blockieren, ohne dass der Betreiber jemals den Klartext deiner Konversation sieht.

Warum das für meine Entscheidung zählt?

Wenn wir die Diskussion über KI-Sicherheit, Datenhoheit und die ethischen Grundlagen der Entwickler bis zum Ende durchdenken, stoßen wir auf eine fundamentale Frage: Wollen wir eine Technologie, die den Menschen erweitert und stärkt – oder eine, die ihn ersetzt, manipuliert oder gar als bloßen Datenpunkt in einem größeren Algorithmus betrachtet?

Die Gefahr eines unkontrollierten Transhumanismus, bei dem die Grenzen zwischen Mensch und Maschine verwischen, ohne dass wir die Kontrolle über unsere eigene Identität behalten, ist real. Sie entsteht dort, wo Profitlogik und technologischer Fortschritt ohne ethischen Kompass voranschreiten.

Genau hier wird meine Entscheidung für Lumo nicht nur zu einer technischen Präferenz, sondern zu einer Haltung. Ich suche keine KI, die mich „verbessern“ will, indem sie meine Daten auswertet und mein Verhalten steuert. Ich suche ein Werkzeug, das mir hilft, meine menschliche Intelligenz zu entfalten – ohne dabei meine Souveränität, meine Privatsphäre und mein Recht auf ein unvoreingenommenes Denken zu opfern.

Nach all der Recherche und den offenen Fragen bleibt für mich nur eine logische Konsequenz:

Mein Fazit: ich versuche es mit Lumo

Nach dem ich Lumo für ein paar Tage ausprobiert hatte, habe ich folgende drei Schritte gesetzt:

- Mein Abo bei ChatGPT gekündigt und das App von meinem Handy gelöscht. Online behalte ich mir meinen Zugang um auf ein paar für ChatGPT programmierte Bots weiter zugriff zu haben.

- Auf QuitGPT meinen Boykott offiziell kundgetan.

- Ein Jahresabo bei Lumo abgeschlossen.

Die Grafikfunktion auf ChatGPT haben ich ohnehin nicht viel genutzt und als ich ein paar Mal probiert haben ein PDF zu generieren, war es nicht zu gebrauchen. Alles andere funktioniert auf Lumo ganz gut. Zu dem hat Lumo den Sitz in Europa und damit für mich gegenüber Signal doch einen entscheidenden Vorteil: Damit habe ich für mich aktuell den stimmigsten Kompromiss gefunden:

Immer noch nicht nachhaltig. Immer noch nicht regenerativ. Aber der Ort, an dem ich aktuell den wenigsten Schaden anrichte — bei vollem Bewusstsein darüber.

Welchen Schritt setzt du, jetzt wo du besser informiert bist?

Nützliches und LInks:

- Das volle Interview (in Englisch) zwischen Nate Hagens und Tristan Harris auf The Great Simplification.

- Der Boykottaufruf für ChatGPT.

Praxistipp für dich

Prompt für KI-Hygiene

Du möchtest, dass die KI bei dir Tricks wie Clickbaits weglässt und ausgewogen recherchiert? Man kann bei den meisten Chatbots in den persönlichen Einstellungen ein Prompt mit allgemeinen Impulsen hinterlegen. Hol dir jetzt deine kostenlose Vorlage.